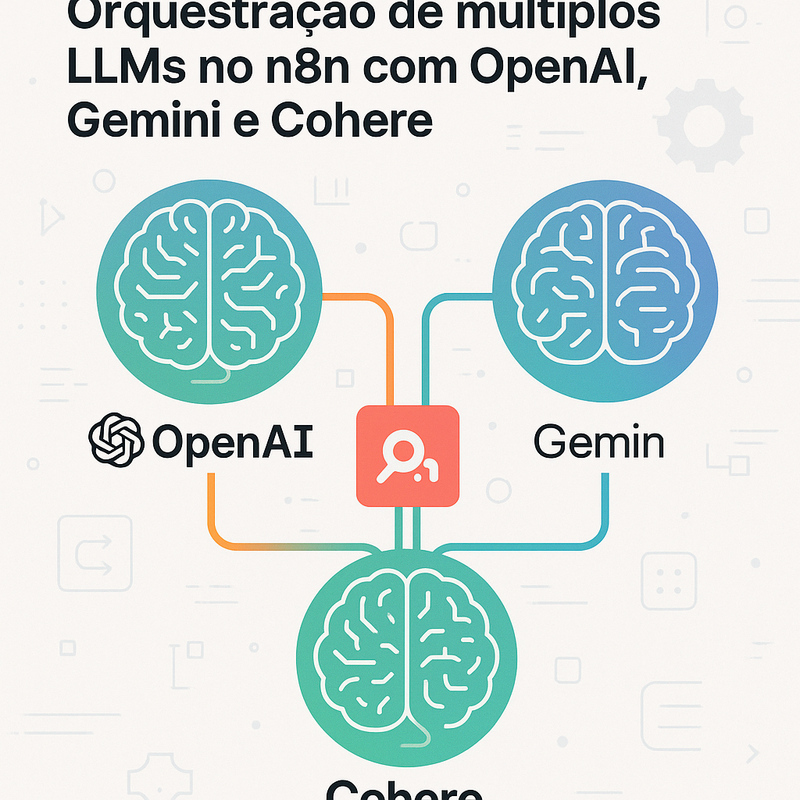

Aprenda como orquestrar múltiplos LLMs no n8n com OpenAI, Gemini e Cohere para criar workflows inteligentes, otimizando automações e expandindo as possibilidades da sua aplicação sem complexidade.

A orquestração de múltiplos LLMs (Large Language Models) no n8n é uma das práticas mais inovadoras para automatizações inteligentes no mercado hoje. Combinar modelos da OpenAI, Gemini e Cohere dentro do mesmo workflow permite extrair o melhor de cada tecnologia, superando limitações individuais e entregando soluções mais completas para empresas e profissionais de automação. Neste artigo, você vai descobrir os principais conceitos de orquestração, como montar workflows inteligentes com diferentes LLMs e dicas práticas para turbinar suas automações no n8n.

Se você está começando nesse universo, fique tranquilo: o n8n oferece uma interface visual, sem código, facilitando a criação e integração dos modelos de IA. Ao unir OpenAI, Gemini e Cohere, você multiplica as capacidades de resposta, criatividade e precisão dos seus projetos automatizados. Vamos mergulhar juntos nesta jornada e transformar a forma como você usa Inteligência Artificial no seu dia a dia!

O que é orquestração de LLMs e seus benefícios no n8n

Orquestração de LLMs significa combinar e coordenar diferentes modelos de linguagem (como OpenAI, Gemini e Cohere) dentro de um mesmo fluxo de automação. Utilizando o n8n, essa técnica se torna acessível até para quem está dando os primeiros passos no mundo da IA, pois não exige programação avançada: tudo é feito de forma visual.

Quais são os principais benefícios dessa abordagem?

- Flexibilidade nas respostas: Cada LLM possui pontos fortes. A OpenAI é ótima em criatividade e linguagem natural, o Gemini se destaca em compreensão contextual, e a Cohere é excelente em processamento de grandes volumes de dados.

- Otimização de custos: Com a orquestração, você seleciona o modelo ideal para cada etapa do seu workflow, evitando uso desnecessário de APIs ou custos elevados com chamadas redundantes.

- Resiliência e redundância: Caso um modelo sofra instabilidade, o workflow pode redirecionar chamadas para outro LLM, reduzindo falhas nas automações.

No n8n, você pode, por exemplo, montar sequências nas quais uma etapa é executada pela OpenAI para gerar um texto criativo, depois o Gemini interpreta sentimentos e, por fim, a Cohere organiza informações. Isso é a essência dos workflows inteligentes com LLMs no n8n!

🤖 Formação Agentes de IA: o caminho mais prático para dominar n8n e automações inteligentes

Se você ficou curioso com o universo dos LLMs, automações visuais e integração de vários serviços de IA, recomendo dar uma olhada na Formação Agentes de IA da Hora de Codar. O curso é muito prático, com aulas passo a passo (mesmo se você nunca programou), focado no n8n e em projetar agentes inteligentes de verdade – daqueles que você monta com blocos visuais e já sai aplicando no trabalho ou projetos pessoais.

Além disso, você aprende de verdade a integrar OpenAI, Gemini, Cohere, bancos vetoriais e APIs, sem perder tempo com teoria inútil. E ainda constrói um portfólio para oferecer soluções como freelancer, consultor ou dentro da empresa. Vale a pena conhecer: Formação Agentes de IA da Hora de Codar.

Principais desafios e diferenciais ao integrar OpenAI, Gemini e Cohere

Integrar mais de um LLM (Large Language Model) em um workflow parece simples, mas existem obstáculos importantes. O primeiro deles costuma ser a gestão de credenciais e limites de API: cada serviço (OpenAI, Gemini, Cohere) tem sua própria forma de autenticação, limites de uso, formatos de resposta e políticas de custo. Pensar nisso logo no início evita dores de cabeça e interrupções nos processos automatizados.

Outro desafio é a padronização das mensagens. Os modelos podem responder em estruturas diferentes (JSON, texto puro, arrays), então você precisa tratar e padronizar esses retornos usando nodes do n8n, como Function ou Set.

Vale destacar também os diferenciais, pois usar múltiplos LLMs torna seu workflow muito mais adaptável:

- Possibilidade de escolher a IA mais barata ou rápida para trechos menos críticos.

- Uso combinado das forças de cada modelo, como a criatividade da OpenAI e a precisão analítica da Cohere.

- Flexibilidade para escalar ou modificar o fluxo facilmente ao surgir um novo serviço ou LLM.

Por fim, lembre-se de monitorar custos, garantir logs claros e priorizar sempre a segurança das informações enviadas para cada modelo.

Vídeo recomendado: Agente de IA inteligente que seleciona o Melhor Modelo – Agente de IA n8n

Este vídeo mostra, na prática, como criar um agente no n8n capaz de escolher automaticamente o melhor LLM conforme o contexto e a necessidade. Ideal para quem quer dominar a orquestração de múltiplos LLMs, combinando OpenAI, Gemini e Cohere para extração máxima de performance em fluxos automatizados. Assista, aprenda e replique no seu workflow!

👉 Não perca! Dê o play para dominar múltiplos LLMs no n8n.

Como integrar múltiplos LLMs no n8n: passo a passo prático

Se você quer começar a orquestrar múltiplos LLMs no n8n com OpenAI, Gemini e Cohere, o processo é acessível mesmo para quem está iniciando:

Configuração das credenciais: No menu lateral do n8n, acesse ‘Credenciais’ e adicione os acessos necessários de cada serviço (chaves de API da OpenAI, Google/DeepMind para Gemini e API Key da Cohere). Siga atentamente as instruções de cada provider.

Adicionando os nodes: Em um workflow novo, busque por nodes “OpenAI”, “Gemini AI” e “Cohere” na barra de busca. Arraste cada um para o canvas. Geralmente, cada node já possui exemplos prontos para facilitar o teste inicial.

Design do fluxo: Conecte a saída de cada node segundo sua lógica de negócio. Por exemplo: um node de ‘Input’ de texto, que primeiro passa pelo OpenAI para reescrita criativa; depois pelo Gemini para análise de humor; e por fim usa o Cohere para sumarizar.

Padronização e testes: Use nodes como Function, Set e Merge para organizar os resultados e padronizar estruturas de saída. Teste o fluxo várias vezes, ajustando prompts, entradas/saídas e monitorando tempos de execução.

Publicação e monitoramento: Após testar e validar o fluxo, publique, deixe-o rodando em segundo plano e monitore eventuais erros usando o painel de execuções do n8n.

Integrar diferentes LLMs abre infinitas possibilidades e deixa suas automações muito mais poderosas. Comece simples e aumente a complexidade gradualmente.

Exemplos de workflows inteligentes com LLMs no n8n

Para ilustrar como a orquestração de múltiplos LLMs potencializa o n8n, confira alguns exemplos de aplicações práticas:

Atendimento automatizado de SAC: Um workflow pode identificar o problema em uma mensagem (OpenAI), avaliar o sentimento do usuário (Gemini) e propor uma resposta coerente e resumida (Cohere).

Geração e validação de conteúdo: Primeiro, o OpenAI cria um texto inicial. Em seguida, Gemini verifica a intenção e adequação. Por fim, Cohere revisa, reorganiza e sugere melhorias, entregando um conteúdo completo e revisado automaticamente.

Análise de múltiplas fontes: Integre informações vindas de diferentes canais, normalize com Cohere, refine o texto com OpenAI e use Gemini para “sentir” tendências em sentimentos ou temas.

Além desses cenários, você pode usar múltiplos LLMs para monitorar redes sociais, automatizar e-mails personalizados, gerar insights de vendas, entre outras soluções. O segredo está em mapear necessidades e testar diferentes combinações até chegar ao workflow inteligente ideal para sua realidade.

💻 Hostinger: a VPS fácil e confiável para seus projetos de n8n

Se você quer rodar automações avançadas e orquestração de múltiplos LLMs no n8n com estabilidade, recomendo a VPS da Hostinger. Os planos são acessíveis já com o n8n pré-instalado, ótima performance, fácil de escalar e painel visual sem complicação. Você paga bem menos do que em soluções SaaS, pode rodar quantos fluxos desejar e ainda conta com 30 dias de garantia.

Além disso, usando o cupom HORADECODAR, você garante desconto exclusivo para leitores do blog! Confira os planos e detalhes neste link: VPS Hostinger para n8n.

Melhores práticas e dicas para automações avançadas com múltiplos LLMs

Adotar automações avançadas com múltiplos LLMs exige alguns cuidados especiais:

- Mapeie claramente entradas e saídas: Defina desde já qual modelo cuida de cada etapa (ex: OpenAI inspira, Gemini analisa, Cohere organiza). Isso evita sobreposição e retrabalho.

- Atenção ao uso de tokens e limites das APIs: Os planos gratuitos possuem restrições. Controle o volume de requisições e, se possível, implemente nodes de delay para evitar bloqueios.

- Centralize logs e monitoramento: Use nodes de log ou integrações com bancos de dados para registrar requisições, respostas e custos. Assim, é mais fácil identificar gargalos e otimizar fluxos.

- Seja modular: Construa blocos reaproveitáveis: por exemplo, um subworkflow só para sumarização, outro só para análise de sentimentos.

Por fim, mantenha-se atento às atualizações dos nodes e APIs: novos recursos surgem frequentemente, tornando possível criar automações cada vez mais avançadas e econômicas no n8n.

O que é orquestração de múltiplos LLMs no n8n com OpenAI, Gemini e Cohere?

A orquestração de múltiplos LLMs no n8n consiste em integrar diferentes modelos de linguagem (como OpenAI, Gemini e Cohere) em um único workflow automatizado. Isso permite combinar os pontos fortes de cada modelo para criar soluções mais inteligentes, eficientes e personalizadas tanto para tarefas simples quanto complexas.

Quais as vantagens de usar vários LLMs no mesmo workflow do n8n?

Usar múltiplos LLMs em um workflow do n8n oferece diversos benefícios, como maior precisão nas respostas, flexibilidade para escolher o modelo mais adequado para cada etapa do fluxo, redução de custos ao direcionar tarefas a modelos mais econômicos e implementação de automações sofisticadas que aproveitam as características exclusivas de cada LLM.

Como posso economizar ao orquestrar OpenAI, Gemini e Cohere no n8n?

Você economiza combinando os LLMs de acordo com suas especialidades e custos: tarefas mais simples ou genéricas podem ser encaminhadas para modelos mais acessíveis (como Gemini ou Cohere), enquanto análises complexas ficam com o OpenAI. Assim, o uso inteligente dos recursos reduz o consumo e resulta em economia nas automações.

Conclusão: potencialize seu workflow orquestrando LLMs no n8n

A orquestração de múltiplos LLMs no n8n com OpenAI, Gemini e Cohere inaugura uma nova era de automações inteligentes, potentes e personalizáveis. Adotar essa abordagem permite criar workflows muito mais precisos, versáteis e econômicos, aproveitando o melhor de cada modelo de IA para diferentes etapas do processo.

Com algumas configurações básicas, criatividade e bons exemplos, até iniciantes conseguem integrar essas soluções e modernizar desde tarefas simples até operações complexas de atendimento, vendas e análise de dados. Aproveite também recursos extras como a Formação Agentes de IA e a VPS da Hostinger para turbinar seu aprendizado e garantir estabilidade total das suas automações.

Orquestrar LLMs é fácil, acessível – e com o n8n, todo o poder da IA está ao seu alcance, pronto para automatizar e transformar seu dia a dia.